深層学習(Deep Learning)とは?非エンジニアが説明してみた。

今回は非エンジニアの視点から、今一番話題の深層学習(ディープラーニング)について説明してみたいと思います。

今の人工知能ブーム(一過性の「ブーム」という言い方はもうそぐわないかもしれません)の立役者とも言えるディープラーニングですが、いわゆるマシンラーニング(機械学習)や、従来の人工知能とは何が違い、何が期待されているのでしょうか?

それぞれの言葉を整理してみる

今年、Google DeepMindが開発したプログラム「AlphaGo」が韓国のトッププロ棋士イ・セドル九段を破った際に、その人工知能の進歩を説明するため「機械学習」、「ディープラーニング」「ニューラルネットワーク」という言葉が一斉に取り上げられました。

この3つは、別々のものなのでしょうか?同じものを指すのでしょうか?

・機械学習

データの傾向や法則を抽出し、解析や予測を行うことが目的とした人工知能のいち分野です。

「教師あり学習」「教師なし学習」「強化学習」などの手法があり、人間がデータを与え予測させる場合、データから法則を機械自身に抽出させる場合、ルールで記述しきれない複雑な状況の判断をさせたい場合にそれぞれの強みを発揮します。

・ニューラルネットワーク

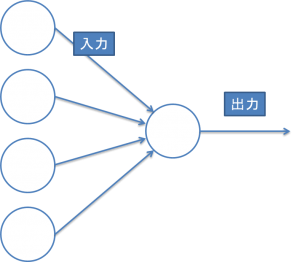

機械学習で扱われる計算アルゴリズムの一種です。

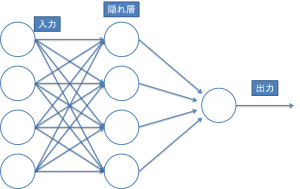

人間の脳を模倣したモデルで、「入力層」「隠れ層」「出力層」の3層構造で成り立っています。

入力から答え(出力)を導き出すのではなく、「隠れ層」で単純な変換を何度も繰り返すことが特徴。

人工知能開発においては初期の頃からすでに存在していましたが、ディープラーニングの躍進で一気に注目を集めるようになりました。

・ディープラーニング

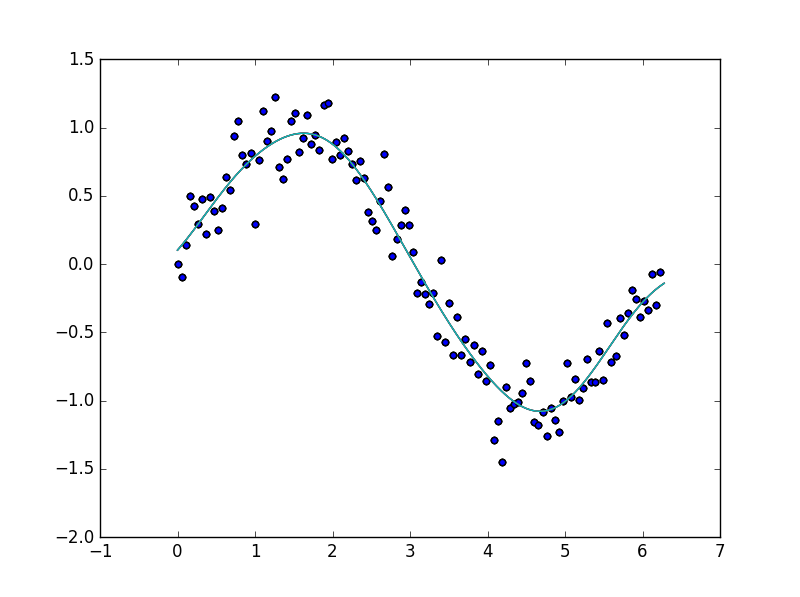

多層構造ニューラルネットワークを用いた機械学習のことを指します。

ニューラルネットワークの「隠れ層」を何層にも重ねることが精度向上につながっており、その深い「隠れ層」構造が「ディープラーニング」の名前の由来となっています。

一般的に4層以上(隠れ層2層以上)がディープラーニングと呼ばれているようです。

ニューラルネットワークの歴史

ディープラーニングを理解するためには、その根幹となる仕組み、ニューラルネットワークを理解するのが近道です。

ニューラルネットワークは、人間の脳の神経回路の仕組みを模した学習アルゴリズムの一種です。

人間の脳はニューロンという細胞が多数つながったネットワーク構造になってます。

コンピュータは単純処理は人間の速度を遥かに凌ぐスピードで処理しますが、人間にとって一般的な情報を整理することや、物を認識する、といったことが苦手です。

この問題を解決するために人間の脳のメカニズム、神経細胞(ニューロン)間のネットワークをコンピュータ上で人工的に再現することにより解決しようというアプローチが生まれました。

第一次ブーム

脳を模倣した計算アルゴリズム自体は1940年頃から始まり、最初の注目を浴びたのは1958年に開発されたパーセプトロンでした。

パーセプトロンは入力層と出力層のみのシンプルな構造でしたが、学習や予測をすることが可能でした。

しかしこのパーセプトロンは

A.明らかに区別ができる(線形分離可能な)データにしか活用ができず、

B.そのための特徴を人間が教えておかねばならないこと、

C.認識の精度を高めるために膨大なサンプルを必要としたこと

などの問題を抱えておりやがてブームは収束します。

第二次ブーム

やがて1986年にはAの問題を解決する、「誤差逆伝搬法」という方法が発明され、新たなブームとなります。

この「誤差逆伝搬法」は、入力層と出力層の間に新たな「層」(隠れ層)を設け、入力されたデータを変換することで「さまざまな角度から見る」ことを可能にする仕組みです。

理論上では、入力層と出力層の間の「隠れ層」が多層になり、階層が深くなることで、抽象的なものも判別できるようになっていくはずでした。

Aの問題が解決したと思われたものの、残念ながらBとCの問題は解決しませんでした。

当時のサンプルデータ数とマシンパワーでは十分な学習を行うことが難しく、大きな成果をあげることができないままブームはまたも収束します。

そして現在…

近年のマシンパワーの向上やインターネット環境の整備による膨大なデータ・サンプルの蓄積によりようやくBとCの問題が解決されようとしています。

ニューラルネットワークが活用できるだけの環境が整い、「隠れ層」の階層を増やすことで膨大なデータを深く深く分類する、「深層学習」が可能になり、第3次ブームが起こっている、というのが現在です。

ニューラルネットワーク多層化によって出来たこと

ディープラーニングの圧倒的な精度を示す2つの出来事が起こったのは2012年。

1つは画像認識コンテスト「ILSVRC(ImageNet Large Scale Visual Recognition Challenge)」でニューラルネットワークを活用したSupervisionという手法が、前年の優勝記録の「誤り率」25.7%を15.3%と大きく改善し圧勝したこと。

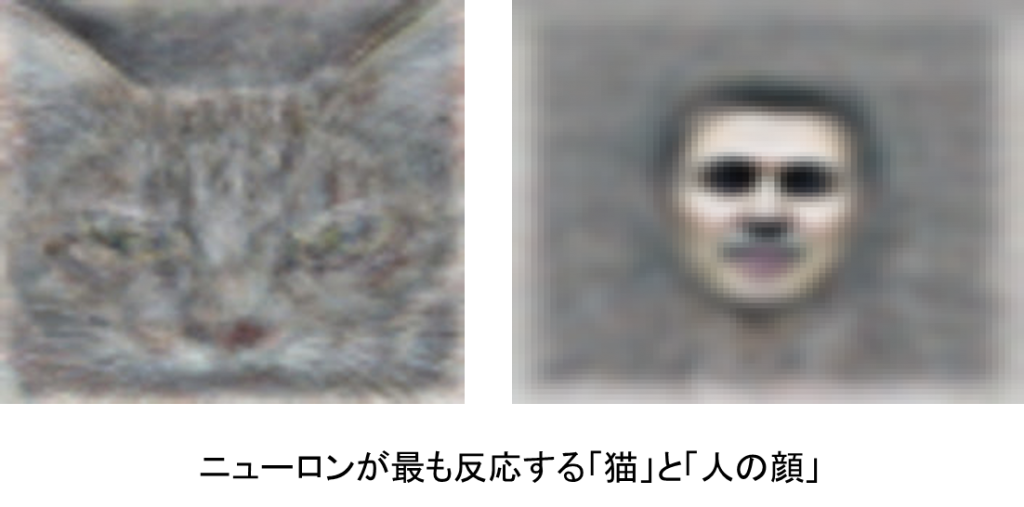

もう1つはGoogleのニューラルネットワークがYouTube動画を学習し、「猫」を自律的に認識したことです。

これは12層ニューラルネットワークによる教師なし学習によるもので、YouTubeにアップロードされている動画からランダムに切り出した200×200ピクセルの画像を1000万枚を学習し「人間の顔」「猫の顔」「人間の体」の写真を識別することに成功しました。

今では画像にある物体を認識するだけでなく,画像の内容を記述する技術も研究されており、特に画像認識での目覚ましい成果については「人工知能を取り入れた画像・動画向けWebサービスを試してみた。」でも取り上げたとおりです。

最後に

ディープラーニングが今のデータ解析、機械学習を全て置き換えてしまうことは考えられませんが、画像、音声、言語といった人間の認識に深く関連する分野では今までの技術を大きく凌駕しつつあります。

ただし「隠し層」でなぜ下層に抽象イメージが獲得されるのか、といった現象についても、その理論は解明されておらず、その内部はブラックボックスのままです。

ディープラーニングは、現在の環境で既存のテクノロジーを使ってみたところものすごい成果が得られた、という実は結果が先行してしまっている技術なのです。

近い将来、人工知能がディープラーニングによりビジネスなどで圧倒的な成果を出してしまった場合、「精度の高い結果を導き出せても、結果がどうやって導き出されたのかがわからない」という状況を人間は受け入れられるでしょうか。

2045年に訪れるといわれる技術的特異点(シンギュラリティ)、少なくともそれまでには人間側が人工知能との付き合い方、使いこなし方を考えておくべきかもしれません。

-

お問い合わせ

SiTest の導入検討や

他社ツールとの違い・比較について

弊社のプロフェッショナルが

喜んでサポートいたします。 -

コンサルティング

ヒートマップの活用、ABテストの実施や

フォームの改善でお困りの方は、

弊社のプロフェッショナルが

コンサルティングいたします。

今すぐお気軽にご相談ください。

今すぐお気軽に

ご相談ください。

(平日 10:00~19:00)

今すぐお気軽に

ご相談ください。

0120-90-5794

(平日 10:00~19:00)

グラッドキューブは

「ISMS認証」を取得しています。

認証範囲:

インターネットマーケティング支援事業、インターネットASPサービスの提供、コンテンツメディア事業

「ISMS認証」とは、財団法人・日本情報処理開発協会が定めた企業の情報情報セキュリティマネジメントシステムの評価制度です。